Deepfake je sve veća prijetnja: Birat će predsjednike lažima i uništavati živote

DOK SU AMERIKANCI slavili produljeni vikend Praznika rada, milijuni ljudi u Kini uključili su se u golem eksperiment budućnosti lažnog videa.

Aplikacija pod nazivom Zao, koja može zamijeniti lice osobe u filmovima i TV snimkama, između ostalog i u seriji "Igra prijestolja", postala je viralna u Appleovoj kineskoj trgovini aplikacijama. Aplikacija je popularna zato što su kreiranje i dijeljenje takvih klipova zabavni, ali u mislima nekih zapadnih promatrača pretvorila se u nešto mnogo zlonamjernije, za Wired piše Tom Simonite.

Prijetnja američkoj predsjedničkoj kampanji

Zaov viralni trenutak brzo je povezan s idejom da su američki političari ranjivi na deepfake, video i audiozapise proizvedene umjetnom inteligencijom kako bi pokazali da osoba radi ili govori nešto što nije ni učinila ni rekla. Ovu prijetnju promovirali su sami američki zakonodavci pa je nedavno i Obavještajni odbor Predstavničkog doma Kongresa imao i raspravu o deepfakeu.

NYU je ovu tehnologiju u izvještaju objavljenom u utorak postavio na vrh popisa dezinformacijskih prijetnji u predsjedničkoj kampanji 2020. godine. Ipak, neki ljudi koji prate utjecaj deepfakea kažu kako nisu američki političari ti koji trebaju najviše strahovati. Umjesto da mijenja sudbinu nacija tako što će progoniti političare, kažu oni, tehnologija će vjerojatno postati oružje manjeg opsega, koja će se koristiti za širenje uznemiravanja i zlostavljanja na internetu.

Jedan od razloga je to što su američke javne osobe, poput predsjedničkih kandidata, već odavno na meti javnosti. Oni su pod stalnim nadzorom političkih suparnika i medijskih organizacija i imaju dobro uspostavljena sredstva za prenošenje vlastitih poruka.

"Takvi videozapisi neće uzrokovati potpuni raspad. Ljudi na takvim pozicijama imaju dovoljno sredstava za dokazivanje autentičnosti fotografija i videozapisa", kaže Henry Ajder, koji se bavi deepfakeovima u Deeptraceu, startupu koji radi na tehnologiji otkrivanja takvih zapisa.

Ne postoji pouzdan detektor deepfakea

Izraz "deepfake" dolazi s računa na Redditu koji je 2017. objavio pornografske klipove s ubačenim licima holivudskih glumica i kasnije objavio kod uz pomoću kojih su zapisi kreirani. Široko rasprostranjene verzije tog softvera i stalni napredak u manipulaciji fotografijama u laboratorijima za umjetnu inteligenciju čine deepfake tehnologiju sve boljom i dostupnijom.

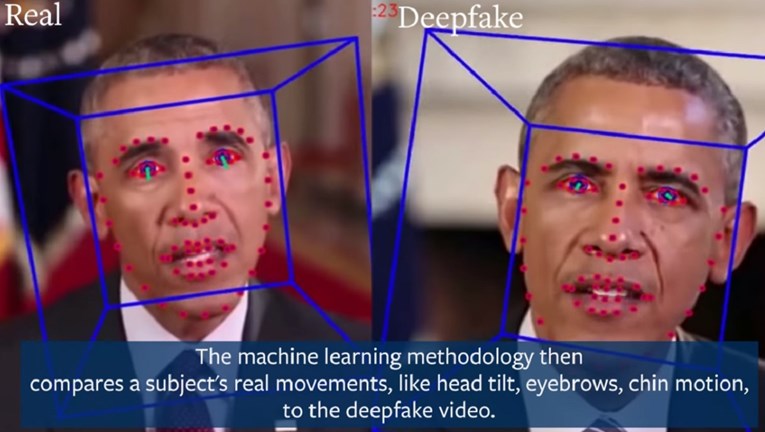

Lažne snimke Baracka Obame i Marka Zuckerberga, stvorene kako bi se demonstrirao potencijal ove tehnologije, imale su milijune pregleda i nahranile su ideje o mogućnosti utjecanja na izbore.

Istraživači i kompanije kao što su Deeptrace pojačali su istraživanje tehnologije za otkrivanje deepfakeova, ali i dalje ne postoji pouzdan detektor.

Ajder kaže kako postoje dobre šanse da će pojaviti deepfake s predsjedničkim kandidatima 2020. godine. No očekuje kako će to biti samo ekstenzija memova i trolanja koja potječe iz online baze fanova pojedinih kandidata, a ne nešto što bi utrku za Bijelom kućom usmjerilo na novu putanju.

U pitanju i zaštita ljudskih prava

Sam Gregory, koji potencijalne učinke deepfakeova prati za neprofitnu organizaciju Witness, koja promovira korištenje videa za zaštitu ljudskih prava, kaže da političari predviđaju sve više lažnih materijala u budućnosti zato što ih oni sami potiču.

Američki republikanski senator iz Nebraske Ben Sasse prošle je godine proglasio da će deepfakeovi "odvesti američku politiku u nekontrolirane uvjete" te predložio zakon koji će kriminalizirati stvaranje i distribuciju deepfakeova sa zlom namjerom.

Adam Schiff, demokratski zastupnik u Predstavničkom domu iz Kalifornije, nedavno je nazvao deepfakeove scenarijem iz noćne more u kampanji 2020.

Gregory vjeruje da aktivisti i novinari iz Južne Amerike, Bliskog istoka i jugoistočne Azije imaju još više razloga bojati se deepfakeova. Zato je u srpnju u Brazilu pomogao organizirati sastanak o deepfakeu za istraživače, novinare, aktiviste i građanske skupine.

Witness je više zabrinut da će deepfake pojačati lokalno uznemiravanje nego da će mijenjati nacionalnu politiku. Novinari i aktivisti koji rade na pitanjima ljudskih prava, kao što su policijska brutalnost i prava homoseksualaca, već se suočavaju s dezinformacijskim kampanjama i uznemiravanjem na platformama kao što je WhatsApp, u kojima se ponekad koriste seksualne snimke.

Najčešći pornografski deepfakeovi

Ono što se zasad zna o deepfakeovima podupire ideju da će ovaj oblik uznemiravanja biti glavni negativni učinak ove tehnologije. Ajder iz Deeptracea zna za postojanje nekoliko slučajeva širom svijeta u kojima je videozapis u središtu političkog skandala bio deepfake, ali nijedan od njih nije potvrđen.

Deeptraceovi pokušaji da prati deepfakeove koji trenutačno cirkuliraju pokazuju da su najčešći pornografski deepfakeovi. Oni su već postali alat ciljanog uznemiravanja, poput osvetničke pornografije. Paul Barrett, autor NYU-ova popisa prijetnji 2020. godine, kojem je deepfake na vrhu, tvrdi da neizvjesnost oko utjecaja deepfakeova ne znači da se u nacionalnoj politici ne treba pripremiti za njih. Dobro plasiran lažni video, objavljen u posljednja 24 sata prije izbora i koji ostavlja malo vremena za odgovor, mogao bi biti presudan.

"S obzirom na iskustva s Rusijom iz 2016. godine, s obzirom na količinu dezinformacija u zemlji, te ponašanje republikanskog kandidata za 2020. godinu na Twitteru i drugdje, preporučio bih pripremu", kaže Barrett.

Gregory iz Witnessa upozorava da takvi pozivi pokazuju kako rasprava o prijetnji deepfakeovima u nacionalnoj politici može imati neželjene posljedice. Ako platforme poput Facebooka ili YouTubea budu pod pritiskom ili obavezom da odmah uklone navodne deepfakeove, njihova obrana mogla bi i sama postati oruđem za manipulaciju stvarnošću. Političari i njihovi pristaše mogli bi iskoristiti alate za prijavu na platformama kako bi suzbili stavove koje ne vole.

"Takvo rješenje moglo bi biti još štetnije za povjerenje javnosti", zaključio je Gregory.

Facebook

Facebook

Google

Google