Treba li samovozeći auto ubiti bebu ili baku?

ŠTO BI SE dogodilo da morate izabrati tko će umrijeti? Vjerojatno se nitko ne bi volio zateći u situaciji da mora donijeti ovakvu odluku, no upravo na toj postavci smišljena je jedna od najpoznatijih moralnih dilema na svijetu, takozvani "problem tramvaja" (trolley problem).

Zamislite da se nalazite u poziciji s koje vidite da će vozilo, ako nastavi voziti svojim putem, ubiti petero ljudi, a ako skrene s puta, umjesto tih petero ubit će samo jednog čovjeka. Vi stojite pokraj sklopke koja upravlja kretanjem vozila. Biste li ga pustili da ide ravno ili biste skrenuli i, kako biste spasili ovih petero ljudi, žrtvovali jednog?

No, što ako postoje dodatne okolnosti koje bi mogle otežati vašu odluku? Bi li promijenili odluku ako bi ta jedna osoba bila dijete, a ovih petero starci? Bi li na vašu odluku utjecala činjenica da biste i sami mogli izgubiti život? Što biste učinili ako biste morali birati između bebe i bake?

Ovo bi mogla postati realnost

Iako ova situacija većini ljudi zvuči jako apstraktno, vozilo bez vozača više nije pojam koji susrećemo samo u SF filmovima. Danas se, razvojem tehnologije i umjetne inteligencije, već u više zemalja testiraju razna autonomna vozila kojima za upravljanje neće biti potreban vozač. U takvim slučajevima ovo moralno pitanje postaje dio algoritma i sve je manje apstraktno. Zaživi li ideja vozila koje upravlja samo sobom, takve će odluke morati biti dio njegovog programa.

2014. problemom su se pozabavili istraživači s MIT Media Laba i odlučili napraviti eksperiment zvan "moralni stroj" kako bi ispitali bi li ljudi iz različitih kultura donijeli različite odluke. Napravili su platformu sličnu igri u kojoj su ljudima bile ponuđeni slični izbori s raznim varijacijama kako bi otkrili koji su skupni etički prioriteti u različitim kulturama.

Viralni moralni eksperiment

Kroz četiri godine eksperiment je postao viralan, pristupili su mu milijuni ljudi iz 233 zemlje i donijeli preko 40 milijuna odluka, zbog čega je ovaj eksperiment postao jedna od najvećih studija moralnog ponašanja.

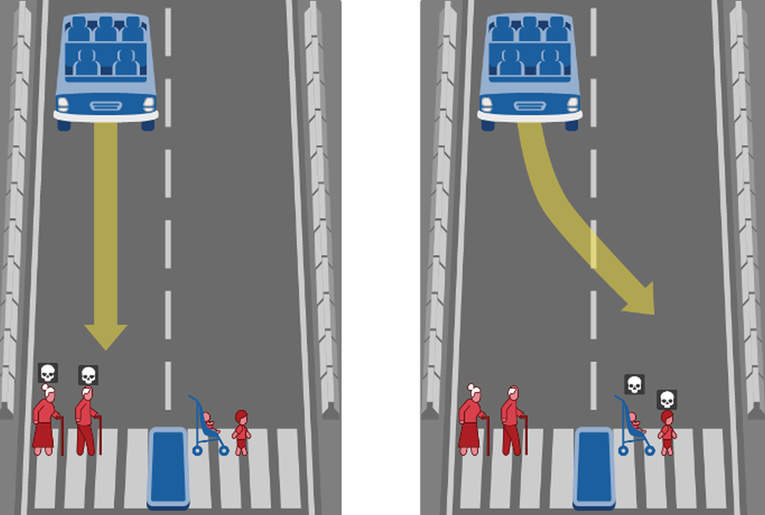

Originalni problem su predstavili u devet različitih varijacija pri čemu su ljudima dali izbor između ljudi i životinja, putnika u vozilu i pješaka, veće i manje skupine ljudi, žena i muškaraca, mlađih i starijih osoba, zdravih i bolesnih, bogatijih i siromašnijih, te onih koji poštuju zakon i zločinaca.

Rezultati istraživanja pokazali su da na odluku koju bi pojedinac donio uvelike utječe kultura u kojoj su odrasli. Primjerice pripadnici kolektivističkih kultura poput Kine ili Japana će rijetko izabrati žrtvovati starije osobe da bi spasili mlađe jer je kod njih poštovanje prema starijima bitan dio kulture, dok će individualističke zapadne kulture izabrati spasiti mlađu osobu.

Isto tako, stanovnici siromašnijih zemalja sa slabijim institucijama će pokazati više tolerancije prema ljudima koji pretrčavaju cestu u usporedbi s onima koji prelaze preko pješačkog, državljani zemalja s velikim socijalnim i ekonomskim razlikama bit će skloniji spasiti bogatije ili siromašnije, a individualističke zemlje poput Velike Britanije ili SAD-a uvijek će spasiti veći broj ljudi nauštrb manjeg, budući da se u njihovim kulturama cijeni vrijednost svakog pojedinca.

Također se pokazalo da će stanovnici zemalja koje se nalaze blizu jedne drugima donositi slične odluke.

Što to znači?

Edmond Awad, jedan od autora istraživanja, naglašava da su oni ovdje pokušali prikupiti podatke o tome što bi ljudi izabrali, a ne nužno o tome da se donesu odluke koje bi bile primjenjive na takve situacije, te da bi njihovi rezultati trebali industriji, ali i vladajućim strukturama, samo postaviti temelje za daljnje razumijevanje ovog problema.

"Koristili smo problem tramvaja jer je to bio dobar način da dođemo do ovakve vrste podataka, ali nadamo se da rasprava o etici u razvoju umjetne inteligencije neće ostati samo na tome. Trebali bismo se također baviti analizom rizika, postaviti pitanje tko je u većoj opasnosti, a ne ga samo svesti na odluku tko će umrijeti", rekao je on.

Facebook

Facebook

Google

Google